focal loss 简述

论文地址来自arxiv

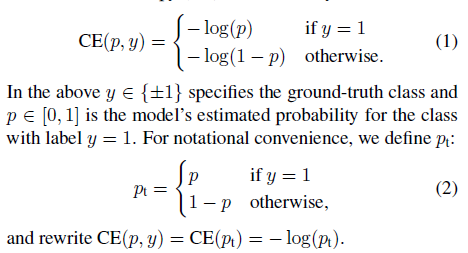

先放focal loss(FL)和cross entropy(CE)两个函数的数学定义。

focal loss 称为焦点损失函数,通过改进标准的二元交叉熵损失函数来控制对正负样本的训练,为了解决在one-stage目标检测中正负样本严重不均衡的一种策略。该损失函数的设计思想类似于boosting,降低容易分类的负样本对损失函数的影响,注重较难分类的正样本的训练。

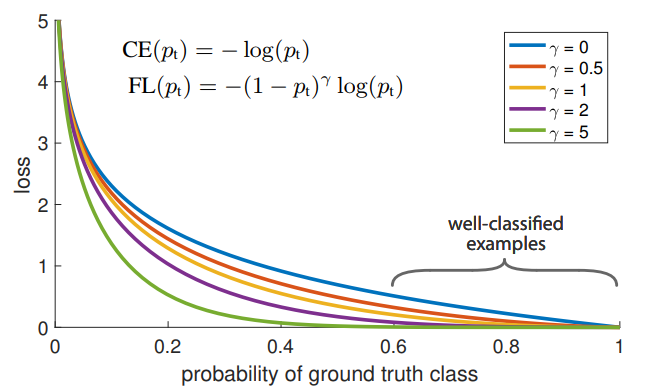

在常规的交叉熵函数的基础上,添加一个系数项,当较容易训练负样本的预测分数较高时,其计算所得的loss将变小,而较难训练的正样本则计算得到更大的loss值,但整体来看计算得到的总loss值比标准的交叉熵计算得到得结果loss更小。从下图曲线得以看出。

公式探讨

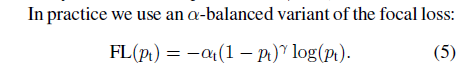

当我们考虑类别的比重不相同时,我们可以给各个类别添加一个权重常数$\alpha$ ,比如正样本权重为0.8,则负样本就为0.2,然后该权重常数乘以对应类别的交叉熵计算中得以生效。

这样就能够平衡正负样本的重要性。但是要解决简单分类和困难分类样本的问题则需要依赖 $\lambda$, $\lambda$ 越大,损失值计算结果越小,这能够实现对容易样本降低权重的平滑调节。对于物体检测,实验发现 $\lambda = 2$时最优。

个人认为该损失函数的设计思想可以应用于其他同样有样本不均衡特点的分类任务。